No son más que simples fórmulas matemáticas, pero están presentes en cada minuto de nuestra vida. Adorados por unos, despreciados por otros, como un cuchillo, los algoritmos son una simple herramienta sin voluntad que, según los utilicemos, pueden mejorar nuestras vidas o destruirlas por completo. Todo depende de cómo los imaginemos.

Artículo de Cristina Suárez

7:30. Lunes. Suena el despertador. Alguien, todavía en los brazos de Morfeo, abre a duras penas un ojo y mira el móvil. Busca qué tiempo hará hoy. Revisa su cuenta bancaria. Decide cómo llegará al trabajo –«¿se retrasará hoy el autobús?», se pregunta mientras busca en la aplicación de rigor–. Se distrae con algunos whatsapps, lee Twitter; hora de prepararse el café. Muy probablemente, también leerá las noticias, quizá se pierda en las profundidades de las tiendas online o reparta unos cuantos likes en su red social favorita. Repetirá el mismo patrón a lo largo de su día, sumando nuevas tareas como el registro de su ritmo cardíaco en una app que le dirá si se encuentra en buena forma, de la misma manera que un calendario de menstruación avisará el día concreto de la ovulación. La aplicación de sueño también le mostrará sus patrones. Y Google Maps. La rutina podría ser la de este lector. O la de cualquier otra persona que tenga un móvil a mano. Su situación socioeconómica, su nacionalidad, sus horarios laborales o sus gustos pueden variar, pero siempre estarán definidos por un denominador común: el algoritmo.

Vuelva a leer el párrafo anterior. Detrás de cada una de esas acciones en la pantalla hay uno trabajando. ¿Cuántos utilizamos, entonces, cada día? Enumerarlos es prácticamente imposible, pero los datos dejan entrever la dimensión que han llegado a alcanzar estas herramientas digitales: según Worldmeters, en este preciso instante hay más de 5.000 millones de usuarios haciendo más de 5.600 millones de búsquedas en Google, enviando 180.000 millones de correos electrónicos y publicando 549.000 millones de tuits. Ahora piense en todas las aplicaciones que cada una de esas personas utilizan en su día a día.

«Los algoritmos funcionan con datos, por lo que van inevitablemente conectados. Prácticamente cualquier herramienta digital con la que interaccionamos lleva un algoritmo», explica la tecnóloga y economista Lucía Velasco. «Sin ir más lejos, el tiempo de pantalla muestra a qué aplicaciones dedicamos más tiempo o en qué momentos del año somos más proclives a usar nuestro teléfono; información que, obviamente, las compañías utilizan para afinar sus productos».

Velasco: «Prácticamente cualquier herramienta digital con la que interaccionamos lleva un algoritmo»

Los algoritmos, en realidad, no son más que simples cálculos matemáticos casi tan antiguos como el homo sapiens. Su padre fue al-Jarsimi, un matemático y astrónomo nacido en el año 780 a. C. cuyo nombre latinizado bautizó este conjunto de instrucciones o reglas definidas y ordenadas que resuelven un problema. Aludiendo a su significado más básico, cualquier indicación, desde una receta de cocina hasta unas instrucciones de juego, incluso las decisiones que tomamos, son algoritmos. En otras palabras, el algoritmo, simple y llanamente, define el pensamiento humano. Y, mezclado con la tecnología, ha constituido la revolución de la que hemos sido testigos en las últimas décadas: la inteligencia artificial (IA).

Su uso no deja de crecer y repartirse por todo el mundo más allá del ámbito puramente social. Recientemente, una encuesta de la consultora McKinsey a empresas de todo el mundo, The State of AI 2021, desveló que la IA ya no solo atañe a los países desarrollados: el 60% de las empresas de economías emergentes respondió que ya ha adoptado esta tecnología. Recurren a ella para operaciones de servicios, marketing, ventas y automatización de la atención al cliente. Todo apunta a que la inversión en inteligencia artificial seguirá aumentando exponencialmente durante los próximos tres años.

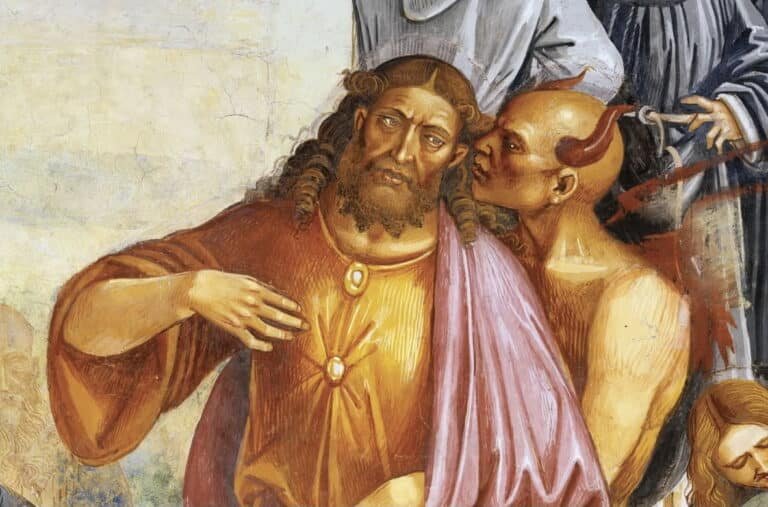

«Todo lo que implique mejorar la toma de decisiones o combatir los grandes retos que tenemos como humanidad y a los que no llegamos es bienvenido a la hora de aplicar algoritmos», resuelve Velasco. «Pero es importante marcar una línea: no es lo mismo que influyan en la gestión de recursos que en la gestión de personas. Y es en todo lo que tenga que ver con el uso de algoritmos y personas donde nos lo tenemos que pensar dos veces: programas para contratación y despido, algoritmos para decidir la dotación de prestaciones, el reconocimiento facial…». Las puntualizaciones de Velasco ante una IA cada vez más normalizada son claras: de la misma forma que en nuestra voluntad está que un cuchillo pueda cortar algo o herir a alguien, dependiendo de los objetivos con los que creemos los algoritmos podrán facilitar vidas (incluso salvarlas), o reducir la capacidad de tomar decisiones, crear burbujas mediáticas y «perpetuar nuestros propios prejuicios».

A Lee Rainie y Janna Anderson, expertos del Pew Research Center, les sobran ejemplos de cómo los algoritmos protagonizan momentos a olvidar: el 7 de octubre de 2016, el valor de la libra se desplomó en segundos debido a la influencia de los algoritmos en los cambios de divisa; Microsoft se vio obligado a eliminar su bot de Twitter, Tay, después de que su algoritmo aprendiera de cientos de tuits y comenzara a enviar mensajes racistas, sexistas y antisemitas; y Facebook acabó eliminando un algoritmo encargado de destacar noticias porque fue incapaz de discernir entre la información real y las fake news.

El 7 de octubre de 2016, el valor de la libra se desplomó en segundos debido a la influencia de los algoritmos en los cambios de divisa

Sin embargo, más allá de los grandes logros tecnológicos, los algoritmos también se ganan sus propias medallas en todos los ámbitos, desde aplicaciones más modernas que contribuyen al diagnóstico de enfermedades de forma precoz hasta la movilidad –el sistema de inyección, los frenos ABS y las turbinas de los aviones funcionan con algoritmos–, protegiéndonos contra el fraude –si el banco nos avisa de un posible robo en nuestra cuenta es gracias a ellos– o haciendo saltar la alarma cuando una puerta de casa se abre en un momento inesperado. Como puntualiza Enrique Dans, profesor de Tecnología en la IE Business School, «el algoritmo no tiene voluntad; se alimenta con los datos», y responderá en consecuencia. Para bien y para mal.

El problema llega cuando, imbuido por los objetivos de la IA, acaba bebiendo de tantos datos que se multiplica en infinitas ramificaciones. Es entonces cuando se vuelve inescrutable –hasta para sus propios creadores– y pone los derechos de los ciudadanos en peligro. Precisamente con el argumento de limitar el caos de su alcance, en 2021 la Comisión Europea tomó la iniciativa mundial en el ámbito legal con la AI Act, una regulación pionera en el mercado tecnológico que evalúa las aplicaciones de IA en función del riesgo que suponen para la sociedad. Las categoriza así: riesgo mínimo –por ejemplo, los videojuegos–, riesgo limitado –chatbots o deep fakes–, riesgo alto –uso en educación, empleo, justicia o inmigración– y prohibidas –puntuación social, reconocimiento facial o manipulación de decisiones–.

«En términos de derechos digitales todavía queda mucho conocimiento que promover entre los ciudadanos», advierte Mark Brakel, director de Legislación Europea en el Future of Life Institute y uno de los promotores de esta propuesta comunitaria, que ha tenido tantos defensores como detractores. De hecho, algunos lobbies tecnológicos aseguran que, de aprobarse la AI Act, la inversión en IA se desplomaría en un 20% en los próximos cinco años y, añaden, al prohibirse herramientas como el reconocimiento facial que se utiliza en los aeropuertos para identificar criminales, las sociedades corren el riesgo de volverse inseguras.

Para Brakel, es una interpretación equivocada. «Si la UE regula la inteligencia artificial, los productores tecnológicos europeos se posicionarán mejor que el resto: los consumidores sabrán que su producto es mucho más seguro que uno chino, por lo que aumentarán las exportaciones al resto del mundo», argumenta. «Y creo que nadie querría vivir en una sociedad completamente a salvo si eso implica ceder sus derechos más básicos. Las tecnologías de reconocimiento de personas pueden detectar cientos de patrones que muestran aspectos íntimos». Y aclara: lo que nos importa, más que prohibir, «es regular la información que recogen estos algoritmos y el uso que hacen de ella».

Una discusión a medias tintas

Es probable que, llegado a este punto del reportaje, los algoritmos le hayan distraído varias veces, redirigiendo su atención. Una notificación de su banco. Un aviso de Alexa. Una advertencia de la app que utiliza para acordarse de beber agua. Quizá llegue a un punto en el que se sienta víctima de un sistema tecnológico que le obliga a estar siempre atento a su dispositivo.

Brakel: «Si la UE regula la inteligencia artificial, los productores tecnológicos europeos se posicionarán mejor que el resto: su producto será mucho más seguro»

«Ese es el problema del que no se habla cuando debatimos sobre los algoritmos: en vez de dedicarnos a reflexionar cómo los hemos estructurado y qué dice eso de nuestra forma de concebir la realidad, externalizamos los problemas al propio algoritmo en sí, cuando no es más que una representación de nuestro propio pensamiento», denuncia Lorena Jaume-Palasí, experta en filosofía del derecho aplicada a la tecnología y miembro del Consejo Asesor de Inteligencia Artificial del Gobierno de España. «Siempre decimos que el algoritmo nos está manipulando, pero a decir verdad esta es una forma de pensar típica de Occidente: renegar de la propia responsabilidad como si fuese obligado por el sistema, cuando en realidad el sistema solo nos ofrece determinados cálculos que hemos construido nosotros mismos», añade.

Tal y como defiende, el intenso –y extenso– debate cojea de un lado invisibilizado: la filosofía del algoritmo. «El problema de la IA es que es humanocéntrica; parte del individuo con el único objetivo de la optimización, una idea que nuestras sociedades siempre han defendido en pos de la eficiencia», explica. «Si se programase de una forma más local, intentando entender para qué y dónde queremos usarla (y asumiendo sus limitaciones), tendríamos algo muy distinto. Ahora mismo es como si intentáramos gestionar todo un bosque partiendo de un solo árbol».

Jaume-Palasí, a diferencia del resto de expertos entrevistados, no cree que la AI Act vaya a romper con el paradigma tecnológico actual. Si el problema de base recae sobre nuestro propio «pensamiento mecanicista» –el mundo como una gran máquina que funciona con distintas piezas individuales–, no importan las regulaciones que se aprueben: nunca daremos con la clave. «Es una regulación mercantil; no tiene nada que ver con los derechos humanos», asegura. «Se trata de ser competitivos, pero no entiende que es un problema de calidad dentro del propio producto y que los riesgos son multidimensionales. ¿Qué pasa si un solo programa presenta tres o cuatro riesgos distintos? ¿Cuál priorizamos?».

La experta lo ejemplifica con la polémica de los fuegos rituales en Australia. Hasta 2021, estas quemas de pasto realizadas por las comunidades aborígenes como representación cultural estuvieron prohibidas por el Gobierno bajo el argumento de que ponían la naturaleza en grave riesgo de incendio. En 2020, durante la catastrófica temporada de fuegos forestales, mientras se buscaban formas de optimizar la lucha contra el fuego a través de la tecnología, un consorcio de tecnológicas aborígenes del noroeste del país revisó esos rituales prohibidos y demostró que ese fuego formaba parte de un proceso anual que se deshacía de la maleza y evitaba, así, incendios mayores.

Jaume-Palasí: «El sistema solo nos ofrece determinados cálculos que hemos construido nosotros mismos»

«A partir de esos rituales, que contemplaban qué tipo de condiciones medioambientales debían tenerse en cuenta para hacer esos fuegos, crearon un calendario con IA y programaron drones de vigilancia. El resultado: en esa zona hubo un 75% menos de fuegos que en el resto del país», concluye Jaume-Palasí. Una muestra de que, para desarrollar la tecnología, primero hace falta comprender el contexto en el que se desea aplicar.

En el día a día de los algoritmos, apunta la experta, lo más imperante es «aprender a escuchar todas aquellas culturas que hemos descalificado». Autores como Aníbal Quijano, María Lubones, Sousa Santos o Silvia Winter llevan décadas avisando de que esta forma de observar el mundo no solo nos lleva a sistematizarlo, sino que puede acabar con él: hay realidades que, simplemente, no son clasificables. «Nos estamos centrando en una carrera tecnológica contra grandes potencias como Estados Unidos o China cuando, realmente, lo que necesitamos es un vínculo internacional que nos lleve a reflexionar sobre si deberíamos construir algoritmos desde otra forma de pensar». En resumen, apunta Jaume-Palasí, no todo es categorizable. Ni debería serlo.

23:00. Silencia su móvil para descansar. No le hace falta poner una alarma: su algoritmo ya la conoce y es capaz de activarla de forma autónoma. Y de silenciar todas las apps hasta las 8:00 del día siguiente. Salvo si es fin de semana, que entonces alargará un poco más el descanso. No se preocupe, el algoritmo lo tiene todo controlado.